Teknik Industri

Apa Itu Produktivitas dan Bagaimana Mengukurnya

Dipublikasikan oleh Anjas Mifta Huda pada 10 Februari 2025

Apa itu produktivitas?

Produktivitas adalah ukuran kinerja yang membandingkan output suatu produk dengan input, atau sumber daya, yang diperlukan untuk memproduksinya. Masukan dapat berupa tenaga kerja, peralatan, atau uang.

Pemerintah AS berfokus pada produktivitas tenaga kerja. Produktivitas ekonomi dihitung sebagai rasio produk domestik bruto (PDB) terhadap jam kerja. Produktivitas tenaga kerja dianalisis berdasarkan sektor untuk mengidentifikasi tren pertumbuhan pekerjaan, upah, dan kemajuan teknologi.

Dalam dunia bisnis, produktivitas adalah ukuran efisiensi proses produksi perusahaan, yang dihitung dengan mengukur jumlah unit produk yang dihasilkan relatif terhadap jam kerja atau dengan mengukur penjualan bersih relatif terhadap jam kerja. Keuntungan perusahaan dan pengembalian pemegang saham secara langsung terkait dengan pertumbuhan produktivitas.

Pokok-pokok penting

- Produktivitas mengukur output per unit input.

- Para ekonom melihat pertumbuhan produktivitas sebagai hal yang penting untuk kenaikan upah, keuntungan perusahaan, dan standar hidup.

- Perhitungan untuk produktivitas adalah output yang dihasilkan oleh perusahaan dibagi dengan unit yang digunakan untuk menghasilkan output tersebut.

- Produktivitas di tempat kerja mengacu pada seberapa banyak pekerjaan yang dilakukan selama periode waktu tertentu.

Produktivitas: mengukur output per unit input untuk mengukur efisiensi produksi.

Memahami produktivitas

Para ekonom melihat produktivitas sebagai sumber utama pertumbuhan ekonomi dan daya saing, baik dalam bisnis, industri, maupun negara.

Kemampuan suatu negara untuk meningkatkan standar hidupnya bergantung pada kemampuannya untuk meningkatkan output per pekerja. Hal ini tidak berarti bahwa setiap pekerja harus bekerja lebih keras. Ini berarti bahwa beberapa kombinasi perbaikan dalam peralatan, proses produksi, dan lingkungan kerja memungkinkan para pekerja secara keseluruhan untuk meningkatkan produksi mereka.

Para ekonom menggunakan pertumbuhan produktivitas untuk memodelkan kapasitas produktif ekonomi dan menentukan tingkat pemanfaatan kapasitas mereka. Hal ini, pada gilirannya, digunakan untuk meramalkan siklus bisnis dan memprediksi tingkat pertumbuhan PDB di masa depan.

Selain itu, kapasitas produksi dan pemanfaatan digunakan untuk menilai permintaan dan tekanan inflasi.

4 jenis ukuran produktivitas

Produktivitas tenaga kerja

Ukuran produktivitas yang paling sering dilaporkan adalah produktivitas tenaga kerja yang diterbitkan oleh Biro Statistik Tenaga Kerja. Ini didasarkan pada rasio PDB terhadap total jam kerja dalam perekonomian. Pertumbuhan produktivitas tenaga kerja berasal dari peningkatan jumlah modal yang tersedia untuk setiap pekerja (disebut pendalaman modal), pendidikan dan pengalaman tenaga kerja (komposisi tenaga kerja), dan peningkatan teknologi (pertumbuhan produktivitas multi-faktor).

Namun, produktivitas tidak selalu menjadi indikator yang dapat diandalkan untuk kesehatan ekonomi pada suatu titik waktu. Sebagai contoh, selama resesi 2009 di Amerika Serikat, output dan jam kerja turun sementara produktivitas meningkat. Artinya, jam kerja turun lebih cepat daripada output.

Peningkatan produktivitas dapat terjadi baik pada masa resesi maupun ekspansi-seperti yang terjadi pada akhir tahun 1990-an-sehingga kita perlu mempertimbangkan konteks ekonomi ketika menganalisis data produktivitas.

Produktivitas faktor total

Banyak faktor yang memengaruhi produktivitas suatu negara. Investasi pada pabrik dan peralatan, inovasi, peningkatan logistik rantai pasokan, pendidikan, perusahaan, dan persaingan semuanya memengaruhi produktivitas.

Sisa Solow, yang biasanya disebut sebagai produktivitas faktor total, mengukur bagian dari pertumbuhan output ekonomi yang tidak dapat dikaitkan dengan akumulasi modal dan tenaga kerja.

Hal ini ditafsirkan sebagai kontribusi terhadap pertumbuhan ekonomi yang dibuat oleh inovasi manajerial, teknologi, strategis, dan keuangan.

Juga dikenal sebagai produktivitas multi-faktor (MFP), ukuran kinerja ekonomi ini membandingkan jumlah barang dan jasa yang diproduksi dengan jumlah input gabungan yang digunakan untuk menghasilkan barang dan jasa tersebut. Input dapat mencakup tenaga kerja, modal, energi, material, dan jasa yang dibeli.

Produktivitas modal

Modal sebagai ukuran produktivitas melihat seberapa efisien modal fisik digunakan untuk menciptakan barang atau jasa. Modal fisik mencakup barang-barang berwujud seperti peralatan kantor, bahan tenaga kerja, persediaan gudang, dan peralatan transportasi.

Produktivitas modal dihitung dengan mengurangi kewajiban dari modal fisik. Anda kemudian membagi angka penjualan dengan selisihnya. Angka produktivitas modal yang lebih tinggi menunjukkan bahwa modal fisik digunakan secara efisien dalam penciptaan barang dan jasa, sementara angka produktivitas modal yang lebih rendah menunjukkan hal yang sebaliknya.

Produktivitas material

Produktivitas material mengukur output dibandingkan dengan jumlah material yang dikonsumsi. Bahan yang dikonsumsi dapat berupa panas, bahan bakar, atau bahan kimia yang digunakan dalam proses pembuatan produk atau jasa.

Ini menganalisis output yang dihasilkan per unit bahan yang dikonsumsi.

Produktivitas dan investasi

Ketika produktivitas gagal tumbuh secara signifikan, kenaikan upah, keuntungan perusahaan, dan standar hidup menjadi terbatas.

Investasi dalam suatu perekonomian sama dengan tingkat tabungan karena investasi dibiayai dari tabungan. Tingkat tabungan yang rendah dapat menyebabkan tingkat investasi yang lebih rendah dan tingkat pertumbuhan yang lebih rendah untuk produktivitas tenaga kerja dan upah riil. Ketika tingkat tabungan di AS rendah, hal ini dipandang dapat merusak pertumbuhan produktivitas di masa depan.

Sebuah pertanyaan besar adalah apa peran pelonggaran kuantitatif dan kebijakan suku bunga nol (ZIRP) dalam mendorong konsumsi dengan mengorbankan tabungan dan investasi. Sebagai contoh, selama periode kebijakan moneter yang longgar di mana kredit dapat diakses dan terjangkau, konsumen lebih cenderung untuk mengambil utang dan mengurangi tabungan mereka untuk mendapatkan hipotek, pinjaman, dan pembelian-pembelian besar lainnya.

Hanya ketika kebijakan moneter diperketat dan suku bunga naik, ekonomi mendorong tabungan dan pada akhirnya investasi di masa depan.

Produktivitas sangat ditentukan oleh teknologi yang tersedia dan kemauan serta pengetahuan manajemen untuk meningkatkan proses.

Perusahaan dapat memilih untuk membelanjakan uangnya untuk investasi jangka pendek dan pembelian kembali saham daripada berinvestasi dalam modal jangka panjang. Beberapa ekonom menyerukan reformasi pajak perusahaan untuk memberikan insentif yang lebih baik bagi investasi di bidang manufaktur, infrastruktur, atau aset jangka panjang.

Produktivitas kerja di rumah

Setelah pandemi COVID-19, beberapa ekonom percaya bahwa para pekerja lebih fokus pada tugas-tugas “bernilai lebih tinggi” yang mengandalkan teknologi, mobilitas, dan skalabilitas.

Karena semakin banyak bisnis yang beralih dari operasi di tempat, investasi infrastruktur alternatif diperlukan untuk menangani entitas hibrida atau sepenuhnya jarak jauh.

Cara menghitung produktivitas

Perhitungan untuk produktivitas sangat mudah: bagi output perusahaan dengan input yang digunakan untuk menghasilkan output tersebut. Input yang paling sering digunakan adalah jam kerja, sedangkan output dapat diukur dalam unit yang diproduksi atau penjualan.

Misalnya, jika sebuah pabrik memproduksi 10.000 widget bulan lalu dengan biaya tenaga kerja 5.000 jam, maka produktivitasnya adalah dua widget per jam (10.000 / 5.000).

Penjualan juga dapat digunakan sebagai ukuran output. Di pabrik yang sama, katakanlah 10.000 widget menghasilkan penjualan sebesar $1 juta. Bagilah angka $1 juta dengan 5.000 jam kerja untuk mendapatkan angka produktivitas: $200 penjualan untuk setiap jam kerja.

Contoh dunia nyata

Raksasa manufaktur mobil Toyota menawarkan contoh utama produktivitas kelas atas dalam kehidupan nyata. Perusahaan ini memiliki awal yang sangat sederhana namun telah berkembang menjadi salah satu produsen mobil terbesar dan paling produktif di dunia. Toyota Production System (TPS) adalah salah satu alasan utamanya.

TPS mencakup beberapa prinsip berikut ini:

- Lingkungan pembelajaran dan peningkatan yang terus-menerus

- Sistem standarisasi untuk kualitas yang konsisten

- Penghapusan (bukan hanya pengurangan) limbah

Dengan menerapkan praktik TPS dalam proses produksi setiap hari, Toyota memastikan bahwa perusahaan terus meningkat dan beroperasi dengan standar yang tinggi, sementara sumber daya tidak terbuang sia-sia.

Apa saja komponen penting dari produktivitas?

Produktivitas dapat diukur untuk setiap individu. Empat komponen penting dari produktivitas individu meliputi

- Strategi, atau kemampuan untuk merencanakan, fokus, atau kemampuan untuk memperhatikan satu tugas dalam satu waktu.

- Memilih yang produktif, atau kemampuan untuk memilih tugas-tugas yang paling penting dan membuat pilihan yang tepat, dan

- Konsistensi, kemampuan untuk bekerja dengan kecepatan yang konsisten dan menggabungkan semua hal di atas dalam tugas-tugas Anda.

Apa yang dimaksud dengan produktivitas di tempat kerja?

Produktivitas di tempat kerja secara sederhana mengacu pada seberapa banyak pekerjaan yang dilakukan selama periode tertentu. Tergantung pada sifat perusahaan, output dapat diukur dengan pelanggan yang diperoleh, panggilan telepon yang dilakukan, dan, tentu saja, penjualan yang ditutup.

Tujuan utama dari sebuah perusahaan adalah memaksimalkan produktivitas tanpa mengorbankan kualitas produk dan tetap efisien dalam menggunakan sumber daya perusahaan.

Bagaimana saya dapat meningkatkan produktivitas pribadi saya?

Beberapa cara dasar untuk meningkatkan produktivitas pribadi setiap hari antara lain:

- Membuat daftar tugas berdasarkan urutan kepentingan dan menanganinya satu per satu

- Menyelesaikan tugas yang paling Anda benci sebelum yang lainnya

- Mengambil waktu istirahat yang diperhitungkan dengan baik untuk meningkatkan produksi secara keseluruhan

- Berolahraga secara teratur

- Makan makanan yang sehat

Faktor apa yang mempengaruhi produktivitas?

Di tempat kerja, faktor-faktor yang memengaruhi produktivitas meliputi kompensasi, lingkungan kerja, pelatihan, peluang pengembangan karier, kesehatan, keragaman, peningkatan tanggung jawab, dan kualitas manajemen.

Bagaimana cara menunjukkan produktivitas di tempat kerja?

Cara untuk menunjukkan produktivitas di tempat kerja adalah dengan menetapkan tujuan, fokus pada satu tugas dalam satu waktu, memenuhi tenggat waktu, tepat waktu, istirahat, fokus pada tugas-tugas terbesar terlebih dahulu, mengosongkan kalender Anda, mengadakan pertemuan yang produktif, dan mendelegasikan tugas.

Intinya

Konsep produktivitas itu sederhana: pada tingkat input tertentu, ada tingkat output tertentu. Masyarakat dan proses yang lebih produktif akan menghasilkan lebih banyak output pada tingkat input yang sama.

Baik dilihat dari sudut pandang ekonomi, sudut pandang perusahaan, atau sudut pandang pribadi, kemampuan untuk mengukur dan melacak produktivitas sangat penting untuk kesuksesan jangka panjang.

Disadur dari: investopedia.com

Teknik Industri

Definisi pekerjaan atau Desain Pekerjaan

Dipublikasikan oleh Anjas Mifta Huda pada 10 Februari 2025

Desain pekerjaan atau pekerjaan digunakan untuk menilai bagaimana tugas atau keseluruhan pekerjaan diatur dalam lingkungan kerja, dan kemudian memastikan bahwa hal ini sesuai dengan atribut karyawan. Meskipun kedua istilah tersebut, desain pekerjaan dan desain pekerjaan (tempat) digunakan secara bergantian, desain pekerjaan memiliki fokus pada perubahan administratif yang diperlukan untuk meningkatkan kondisi kerja, dengan desain pekerjaan memiliki pendekatan yang lebih pragmatis dan menangani penyesuaian yang mungkin diperlukan pada stasiun kerja, alat, dan posisi tubuh untuk memungkinkan pekerja berfungsi lebih efektif.

Pekerjaan yang dirancang dengan baik menjamin bahwa pekerja dapat menyelesaikan apa yang dibutuhkan dengan cara yang aman dan sehat, dan dengan demikian mengurangi ketegangan fisik dan psikologis. Selain itu, hal ini juga membantu pengorganisasian pekerjaan, misalnya dalam mengidentifikasi isu-isu seperti: beban kerja yang berlebihan, pengulangan, dan kontrol yang terbatas terhadap pekerjaan; dan dengan demikian meningkatkan keselamatan dan kesehatan kerja (K3) di dalam organisasi. Pekerjaan yang dirancang dengan baik dapat menghasilkan karyawan yang lebih terlibat, sehat, dan produktif, dan hasil ini akan menguntungkan karyawan dan organisasi.

Relevansi desain pekerjaan atau pekerjaan dengan organisasi

Sudah menjadi keyakinan umum bahwa semua aktivitas kerja akan memiliki tuntutan fisik dan mental pada pekerja; jika hal ini dijaga pada tingkat yang dapat diterima, maka kinerja dapat dipertahankan, begitu juga dengan kesehatan dan kesejahteraan pekerja; namun jika tuntutan tersebut melebihi kemampuan pekerja, maka kesalahan, kecelakaan, cedera, dan penurunan kesehatan fisik dan mental dapat terjadi. Penerapan prinsip-prinsip desain pekerjaan harus membantu dalam mengidentifikasi fasilitas, perabot, mesin dan peralatan yang sesuai yang dirancang dan dialokasikan agar sesuai dengan atribut pekerja, termasuk ukuran, kekuatan, kapasitas aerobik, kapasitas pemrosesan informasi, dan ekspektasi. Ketika kecocokan antara pekerja dan lingkungan ini berhubungan dengan aspek psikososial dari pekerjaan, maka hal ini dikenal sebagai kesesuaian antara orang dan lingkungan, yaitu bahwa tuntutan organisasi sesuai dengan kemampuan karyawan.

Desain pekerjaan atau pekerjaan, sebagai sebuah proses, dapat mengatasi faktor-faktor dalam lingkungan kerja, misalnya kontrol, kelebihan atau kekurangan beban kerja, aspek ergonomi yang terkait dengan gangguan muskuloskeletal (MSD), kerja shift, pengulangan, jam kerja yang berlebihan, stres/ ketegangan kerja, dan pemahaman yang terbatas tentang proses pekerjaan. Dengan demikian, salah satu tujuannya adalah untuk meningkatkan produktivitas dan iklim psikososial. Tujuan lainnya dapat mencakup peningkatan kesehatan karyawan dengan memberikan mereka lebih banyak kendali dalam pekerjaan dan dengan demikian mengurangi stres terkait pekerjaan yang dapat mengakibatkan masalah kesehatan yang serius seperti misalnya infark miokard.

Karena sifat lingkungan kerja yang berubah, yaitu beralih ke ekonomi jasa yang lebih kuat, meningkatnya jumlah wanita dalam angkatan kerja dan banyaknya pekerja yang lebih tua yang tetap dipekerjakan untuk waktu yang lebih lama daripada sebelumnya; persyaratan untuk desain pekerjaan yang baik dan/atau desain pekerjaan yang baik sangat penting untuk mempertahankan karyawan yang produktif, aman, dan sehat. Selain itu, pekerjaan semakin tidak terlalu berfokus pada aspek fisik dari pekerjaan, tetapi lebih berkonsentrasi pada penggunaan proses mental. Ada juga persepsi bahwa ketika pekerjaan menjadi lebih kompleks, hal ini mengaburkan batas antara aktivitas mental dan fisik. Pengaruh terhadap konteks dan kompleksitas pekerjaan dan pekerjaan termasuk globalisasi, produksi yang ramping, otomatisasi, perubahan dari tugas-tugas yang monoton ke tugas-tugas yang kompleks, dan peningkatan pekerjaan yang terkait dengan peningkatan tingkat pendidikan pekerja. Faktor-faktor ini tidak stagnan dan seiring dengan perubahan masyarakat dan makna 'kerja' yang terus berkembang, dinamika bagaimana pekerjaan dan pekerjaan dilakukan juga akan berkembang.

Manfaat dari desain pekerjaan atau pekerjaan yang sesuai

Cara mendesain pekerjaan memiliki dampak yang besar terhadap sikap, keyakinan, dan perasaan karyawan. Hal ini termasuk komitmen organisasi, motivasi kerja, kinerja, kepuasan kerja, kesehatan mental, mengurangi perputaran dan ketidakhadiran karena sakit. Desain yang buruk juga berdampak pada biaya pelatihan dan pelatihan karena desain yang buruk dapat meningkatkan waktu untuk mempelajari sistem, dan membutuhkan lebih banyak pelatih yang terampil dan karyawan yang lebih terampil.

Manfaat yang dapat diperoleh ketika desain pekerjaan atau pekerjaan dinilai disorot dalam sebuah penelitian yang menunjukkan bahwa meskipun penyesuaian waktu istirahat di antara para pekerja di pabrik pengolahan daging tidak mengurangi produktivitas, salah satu hasil yang biasa diperoleh dari desain pekerjaan atau pekerjaan, namun hal itu meningkatkan kesejahteraan. Studi ini menggambarkan bahwa penyesuaian yang relatif murah terhadap lingkungan kerja dapat memberikan hasil yang positif bagi karyawan dan organisasi.

Proses desain pekerjaan atau pekerjaan

Desain pekerjaan dan pekerjaan harus dilakukan di dalam organisasi ketika sebuah pekerjaan baru diciptakan atau ketika pekerjaan dan pekerjaan tidak lagi sesuai dengan pekerja atau melebihi kapasitas seorang karyawan. Hal ini ditunjukkan ketika pekerja menunjukkan kondisi kesehatan yang buruk, seperti ketegangan muskuloskeletal atau ketegangan psikososial, dan biasanya merupakan waktu ketika intervensi diperlukan untuk mengatasi dampak buruk dari pekerjaan. Namun, organisasi yang efektif harus memiliki prosedur pemantauan untuk menilai secara terus menerus tingkat keselamatan, kesehatan, dan kinerja pekerja; dan dengan demikian mengurangi kesehatan yang buruk. Penilaian pekerjaan atau tugas secara berkala lebih baik karena harus dapat mengidentifikasi apakah perubahan atau penyesuaian diperlukan pada cara pekerja melaksanakan tugasnya.

Ada berbagai elemen dari dan dalam lingkungan kerja yang harus dipertimbangkan ketika mengatur atau melaksanakan desain pekerjaan atau pekerjaan, karena dapat mempengaruhi efektivitas karyawan. Beberapa di antaranya adalah: lingkungan yang dingin (untuk mengurangi stres dingin) kemampuan fisik pekerja, seperti 'jangkauan' jika perlu menggerakkan tubuh bagian atas dalam menyelesaikan tugas mencocokkan pekerja dengan pekerjaan untuk memastikan bahwa kontrol yang diperbolehkan adalah apa yang dibutuhkan atau diperlukan oleh pekerja atau bahwa tuntutan pekerjaan memenuhi kemampuan pekerja untuk melaksanakan tuntutan tersebut. Elemen-elemen lain yang harus dipertimbangkan, karena dianggap sebagai faktor risiko adalah: pengerahan tenaga yang kuat, posisi yang canggung, tekanan kontak mekanis yang terlokalisasi, getaran, suhu yang ekstrem, pengerahan tenaga yang berulang-ulang, dan pengerahan tenaga atau postur statis yang berkelanjutan atau berkepanjangan.

Sumber: oshwiki.osha.europa.eu

Tabel 1: Tahapan dalam desain pekerjaan

Hasil akhir dari setiap intervensi pekerjaan atau desain pekerjaan adalah untuk mencapai pekerjaan dengan kualitas sebagai berikut:

- Variasi tugas. Upaya harus dilakukan untuk menyediakan variasi tugas yang optimal dalam setiap pekerjaan. Terlalu banyak variasi dapat menjadi tidak efisien untuk pelatihan dan membuat frustasi karyawan. Terlalu sedikit dapat menyebabkan kebosanan dan kelelahan. Tingkat yang optimal adalah yang memungkinkan karyawan untuk beristirahat dari tingkat perhatian atau usaha yang tinggi saat mengerjakan tugas lain atau, sebaliknya, untuk melakukan peregangan setelah periode aktivitas rutin.

- Variasi keterampilan. Penelitian menunjukkan bahwa karyawan memperoleh kepuasan dari penggunaan sejumlah tingkat keterampilan.

- Umpan balik. Harus ada beberapa cara untuk memberi tahu karyawan dengan cepat ketika mereka telah mencapai target mereka. Umpan balik yang cepat membantu proses pembelajaran. Idealnya, karyawan harus memiliki tanggung jawab untuk menetapkan standar kuantitas dan kualitas mereka sendiri.

- Identitas tugas. Kumpulan tugas harus dipisahkan dari kumpulan tugas lainnya dengan suatu batasan yang jelas. Jika memungkinkan, kelompok atau individu karyawan harus memiliki tanggung jawab untuk satu set tugas yang didefinisikan dengan jelas, terlihat, dan bermakna. Dengan cara ini, pekerjaan dipandang penting oleh kelompok atau individu yang melaksanakannya, dan orang lain memahami dan menghormati arti pentingnya.

Otonomi tugas. Karyawan harus dapat melakukan kontrol atas pekerjaan mereka. Area keleluasaan dan pengambilan keputusan harus tersedia bagi mereka.

Berbagai aspek desain pekerjaan dapat dimasukkan ke dalam sebuah model sehingga tahapan desain hingga output dapat terlihat dengan jelas, seperti yang ditunjukkan pada Gambar 1. Gambar 1 menunjukkan karakteristik pekerjaan yang harus dimasukkan ke dalam desain apa pun, serta faktor-faktor yang memengaruhi faktor-faktor tersebut, seperti tanggung jawab, dan hasil yang diharapkan, misalnya kesejahteraan, pada akhir proses yang dirancang dengan baik.

Sumber: oshwiki.osha.europa.eu

Gambar 1: Model integratif dari desain pekerjaan

Biaya desain pekerjaan atau pekerjaan

Efektivitas biaya dari intervensi desain pekerjaan/jabatan jarang dihitung, dan ketika hal ini digabungkan dengan rendahnya pelaporan tentang intervensi yang tidak berhasil, membuatnya sulit untuk menilai secara menyeluruh desain-desain yang paling berguna untuk dipromosikan ke organisasi lain. Jika organisasi ingin menyadari pentingnya dan manfaat biaya dari melakukan desain pekerjaan/pekerjaan secara konsisten, maka mereka perlu melihat efektivitas melakukan jenis intervensi ini. Hal ini dapat diperoleh dengan melakukan pencatatan yang tepat mengenai apa yang telah terjadi, kapan hal itu terjadi dan hasil yang menguntungkan atau tidak menguntungkan.

Namun, biaya dari konsekuensi desain yang buruk dan sinkronisasi yang buruk antara pekerja dan pekerjaan dapat dihitung. Sebagai contoh, MSDs dapat terjadi karena desain yang buruk. Meskipun MSDs mungkin tidak terkait dengan pekerjaan karena mempengaruhi otot, sendi, tendon, dan bagian lain dari sistem muskuloskeletal, MSDs berdampak pada kemampuan kerja karyawan. MSDs menyumbang proporsi yang lebih tinggi dari ketidakhadiran karena sakit di tempat kerja daripada kondisi kesehatan lainnya, yang berjumlah sekitar setengah dari semua gangguan terkait pekerjaan di negara-negara anggota Uni Eropa. Dari segi ekonomi, diperkirakan hingga dua persen dari produk domestik bruto (PDB) disebabkan oleh biaya langsung MSDs setiap tahunnya. Di Belanda, misalnya, cedera regangan berulang (RSI) di tempat kerja menelan biaya €2,1 miliar setiap tahun. Terlalu banyak MSDs yang disebabkan oleh pekerjaan dapat dicegah dengan organisasi kerja yang lebih baik, desain pekerjaan dan melalui intervensi ergonomis. Di Inggris, MSDs adalah penyebab paling umum dari penyakit akibat kerja di Inggris, yang saat ini mempengaruhi satu juta orang per tahun dan merugikan masyarakat sebesar £5,7 miliar.

Cara untuk memastikan desain pekerjaan atau pekerjaan yang baik

Desain pekerjaan yang baik akan, misalnya, melibatkan karyawan, memberikan umpan balik yang baik tentang kinerja, serta menyeimbangkan pekerjaan statis dan dinamis. Penting untuk menilai aspek kognitif dari pekerjaan dan juga aspek fisik, karena hanya memperbaiki bahaya fisik dalam pekerjaan tidak akan mewujudkan hasil yang berkelanjutan dalam meningkatkan kinerja karyawan. Faktor lain yang perlu dipertimbangkan adalah faktor orang, seperti usia, karena usia merupakan alasan yang berkontribusi terhadap bagaimana tugas-tugas dilakukan, tetapi hal ini dapat dikurangi dengan pelatihan dan pengalaman dan untuk mengendalikan kelebihan beban.

Gender adalah faktor lain yang harus dimasukkan ke dalam desain pekerjaan atau pekerjaan, terutama mengingat meningkatnya jumlah perempuan dalam angkatan kerja. Desain pekerjaan atau pekerjaan harus memperhitungkan juga kemampuan fisik dari masing-masing pekerja, daripada menggunakan data berdasarkan 'rata-rata' karyawan. Hal ini termasuk jenis kelamin, karena perempuan dan laki-laki pada umumnya memiliki kapasitas fisik yang berbeda. Dengan demikian, deskripsi pekerjaan stereotip mungkin tidak sesuai untuk semua karyawan dan hal ini dapat diatasi melalui observasi dan melakukan tes sederhana atau pengukuran kekuatan, kebugaran fisik, dan bakat yang dikalibrasi secara hati-hati untuk 'menyesuaikan' pekerjaan dengan pekerja. Lebih lanjut, adalah mungkin untuk meningkatkan kapasitas pekerja melalui program pengkondisian fisik dan pelatihan kerja awal.

Sehubungan dengan faktor usia, sebuah penelitian terhadap petugas pemadam kebakaran dan polisi Finlandia yang lebih tua menunjukkan bahwa mereka telah mengurangi kapasitas kerja fisik, yang dapat menyebabkan kelelahan dan meningkatkan risiko cedera dalam situasi beban puncak pekerjaan. Diusulkan agar petugas pemadam kebakaran dan polisi terlibat dalam pelatihan fisik yang teratur dan efektif untuk mempertahankan tingkat kapasitas kerja fisik yang cukup tinggi. Secara keseluruhan, disarankan agar pekerjaan didesain ulang untuk menangkal efek penuaan. Beban kerja fisik yang lebih rendah yang dialami oleh banyak pekerja saat ini dapat mengurangi kesehatan karena aktivitas fisik yang lebih rendah dan diusulkan agar pekerjaan dirancang untuk mempertimbangkan faktor ini.

Cara sederhana lain untuk memperbaiki desain pekerjaan adalah dengan memastikan bahwa alat pelindung diri (APD) yang tersedia untuk karyawan benar-benar sesuai. Umumnya, APD dirancang untuk pekerja pria kulit putih berukuran rata-rata, yang mungkin tidak menguntungkan dan berbahaya bagi pria, yang mungkin tidak termasuk dalam kisaran ukuran rata-rata, seperti halnya bagi wanita dan kelompok etnis yang juga mungkin tidak mencerminkan ukuran rata-rata karyawan. Kelompok-kelompok yang terakhir ini mungkin mendapati bahwa mereka tidak dapat memperoleh APD yang pas dan tersedia.

Cara lain untuk memperbaiki desain pekerjaan adalah dengan mengamati secara langsung karyawan yang sedang bekerja, daripada menilai melalui wawancara atau kuesioner terstruktur. Hal ini terutama penting untuk pekerjaan di sektor jasa dengan pekerja yang diharuskan menggunakan peralatan tertentu, namun tidak sesuai dengan 'norma' dalam hal ukuran. Satu studi di sektor ritel yang mengamati karyawan perempuan menggunakan pemindai laser mampu mengamati masalah yang menyebabkan, misalnya, kelelahan (postur tubuh, jangkauan, tugas-tugas yang janggal, panjangnya jam kerja, tekanan untuk bekerja dengan cepat) dan MSDs (postur tubuh yang tidak nyaman, tempat duduk, misalnya, hubungan antara tempat duduk dengan ketinggian meja). Pengamatan langsung ini memungkinkan masalah operasional untuk dilihat sebagaimana adanya, terutama dalam konteks pekerja 'lebih kecil' yang harus menggunakan peralatan ukuran 'rata-rata'.

Pekerjaan dapat dinilai dengan langkah-langkah yang dirancang khusus seperti Job Diagnostic Survey (JDS) dan Multimethod Job Design Questionnaire (MJDQ) yang menargetkan berbagai elemen pekerjaan, termasuk tugas, keterampilan, motivasi, dan otonomi. Langkah-langkah terbaru termasuk Work Design Questionnaire (WDQ), yang bertujuan untuk memberikan penilaian yang komprehensif terhadap proses desain pekerjaan atau kerja, termasuk karakteristik tugas, variasi tugas, pemrosesan informasi, pemecahan masalah, dan variasi keterampilan.

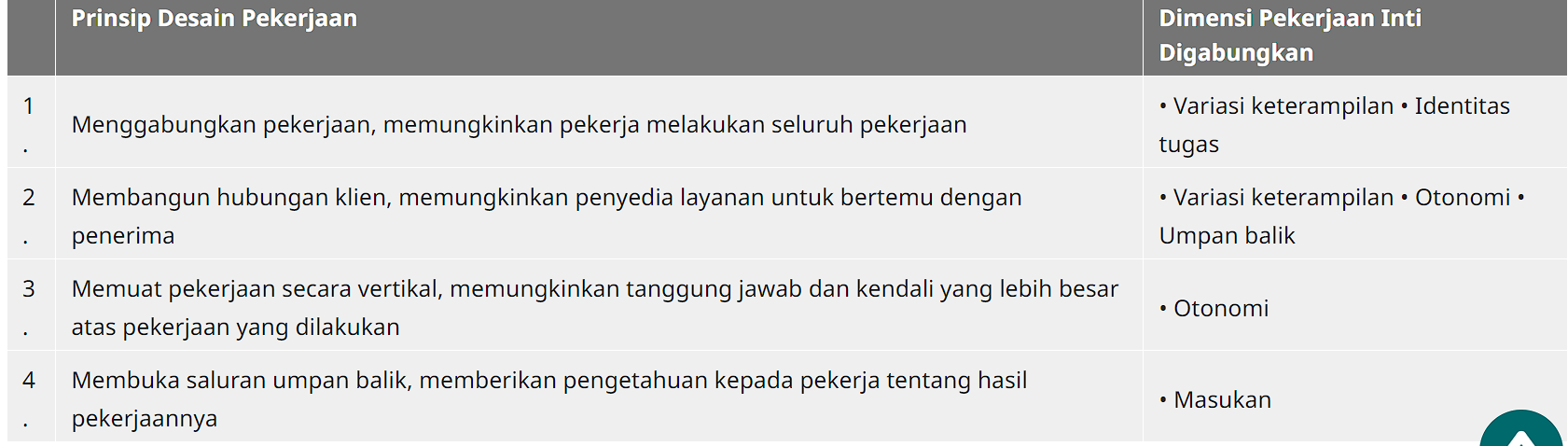

Proses pengayaan/peningkatan pekerjaan ini ditunjukkan pada Tabel 2.

Tabel 2: Beberapa saran untuk memperkaya pekerjaan

Pendekatan holistik

Ada penelitian terbaru yang menunjukkan bahwa pendekatan holistik terhadap desain pekerjaan/pekerjaan merupakan pilihan yang lebih layak untuk memastikan bahwa pengalaman dan kebutuhan individu dimasukkan ke dalam proses. Ini berarti mencakup biologi, ekonomi, sosiologi, dan antropologi, di samping elemen psikologis yang menilai 'orang' dan bukannya terikat pada penerapan atribut yang telah ditetapkan sebelumnya pada pekerjaan, dan orang tersebut, seperti growth need strength (GNS). GNS mengacu pada 'kekuatan keinginan responden untuk mendapatkan kepuasan “pertumbuhan” dari pekerjaannya yang tercermin dalam memperoleh otonomi, kemandirian, rasa pencapaian dan aktualisasi diri.

Kegunaan dari perspektif ini ditunjukkan dalam penilaian terhadap petugas kebersihan di Denmark yang diberikan peralatan dan bentuk organisasi kerja baru untuk meningkatkan efisiensi, namun ternyata memiliki dampak negatif terhadap kesehatan petugas kebersihan. Penyelidikan lebih lanjut menunjukkan bahwa peralatan baru tersebut tidak mengurangi dampak pada tingkat beban otot atau beban pada jantung mereka. Para peneliti merekomendasikan untuk mengambil strategi yang lebih komprehensif untuk mendesain ulang pekerjaan. Perkembangan menuju pendekatan yang lebih komprehensif bahkan lebih penting karena tampaknya proses desain pekerjaan atau pekerjaan mungkin tidak berkembang sebanyak yang seharusnya. Penelitian selama hampir empat puluh tahun menunjukkan bahwa penggunaan satu atau dua faktor ketika mendesain ulang pekerjaan tidak memberikan dampak positif terhadap motivasi pekerja, keterlibatan kerja, kepuasan akan pertumbuhan, atau meningkatkan hubungan dekat mereka.

Faktor-faktor yang perlu dimasukkan dalam pendekatan holistik

- Tujuan: Model desain pekerjaan perlu mempertimbangkan lebih banyak tujuan yang memotivasi dan mengarahkan para pekerja, dan bagaimana tujuan-tujuan tersebut berubah sesuai dengan kondisi kehidupan. Hal ini dapat memperoleh manfaat dari kerangka kerja pengaturan mandiri yang memungkinkan prediksi berbagai strategi adaptif (mengubah tujuan, mengubah persepsi, mengubah perilaku, penilaian diri) yang dapat digunakan individu ketika mengambil peran, atau selama durasi jabatan yang diperpanjang.

- Perbedaan individu: Apresiasi yang lebih dalam diperlukan untuk peran perbedaan individu yang stabil dalam adopsi dan kinerja peran kerja seseorang. Hal ini akan sangat tepat dalam menilai sejauh mana para pemegang jabatan secara aktif berusaha untuk 'membuat' atau secara lebih radikal mengubah pekerjaan mereka, dan bagaimana mereka menilai risiko dalam melakukan hal tersebut.

- Jenis kelamin: Berbagai prediksi dapat diuji seputar preferensi dan pilihan yang secara khas dibuat oleh laki-laki dan perempuan dalam beberapa parameter utama peran kerja, termasuk cara pemberlakuan, respons terhadap insentif, pengejaran status, dan hasil lainnya.

- Status: Sebagai tujuan utama sebagian besar karyawan (tergantung pada variasi gender dan perbedaan individu), hal ini mungkin perlu mendapat perhatian yang lebih terpisah dari yang selama ini diterima, karena hal ini sangat penting tidak hanya untuk parameter desain pekerjaan yang sudah dikenal, seperti keleluasaan, tetapi juga untuk berbagai hasil yang dihargai. Kemungkinan pencarian status yang mengganggu aspek lain dari kesesuaian orang-pekerjaan secara khusus dapat diselidiki.

- Konteks kelompok: Bagaimana pekerjaan tertanam dalam jaringan interaksi dan asosiasi juga merupakan pertimbangan utama untuk memahami bagaimana orang merespons tekanan, insentif, dan aturan. Kerja sama dan perilaku yang saling melengkapi dapat dengan mudah diinduksi oleh kerangka kerja manajemen. Peran supervisor sebagai elemen aktif dalam evolusi bersama dari respon karyawan terhadap pekerjaan juga terlibat.

- Kontak yang lebih luas: Argumen ko-evolusi adalah bahwa lingkungan kerja beroperasi sebagai budaya, dan terkadang berkomitmen, di mana strategi yang berbeda untuk mengoptimalkan kesesuaian antara orang dan pekerjaan dapat diterapkan. Pendekatan evolusioner membutuhkan integrasi dari berbagai tingkat analisis dan dapat membantu bidang ini untuk mengintegrasikan sejumlah besar teori tingkat menengah saat ini seputar topik-topik dalam desain pekerjaan.

Penting untuk disadari bahwa proses desain pekerjaan/pekerjaan harus dilihat sebagai proses jangka panjang dan berkesinambungan, jika ingin mendapatkan dampak yang efektif dan berkelanjutan. Meskipun penilaian jangka pendek berguna dan akan mewujudkan perubahan, desain ulang pekerjaan/pekerjaan yang dilakukan dalam jangka waktu yang lebih lama akan memungkinkan evaluasi pada berbagai tahap proses untuk mengukur kemajuan dalam hasil, dan dengan demikian menentukan apakah ini mencapai hasil yang diperlukan atau perlu disesuaikan.

Kesimpulan

Desain pekerjaan telah berevolusi dan terus berkembang untuk memenuhi tuntutan lingkungan kerja yang dinamis. Pendekatan holistik yang sejalan untuk mendapatkan hasil dari keunggulan organisasi melihat adanya pergerakan dari desain pekerjaan ke strategi perbaikan yang terintegrasi yang merupakan salah satu yang dimasukkan ke dalam prinsip-prinsip kerja organisasi dan tidak dilihat sebagai intervensi 'sekali saja'.

Disadur dari: oshwiki.osha.europa.eu

Teknik Industri

Prinsip-Prinsip dan Aplikasi Riset Operasi

Dipublikasikan oleh Anjas Mifta Huda pada 10 Februari 2025

Bab ini akan memberikan gambaran umum mengenai Riset Operasi (RO) dari sudut pandang seorang insinyur industri. Fokus dari bab ini adalah pada filosofi dasar di balik O.R. dan apa yang disebut “pendekatan O.R.” untuk memecahkan masalah desain dan operasional yang biasa dihadapi oleh para insinyur industri. Dalam bentuknya yang paling dasar, O.R. dapat dipandang sebagai pendekatan ilmiah untuk memecahkan masalah; pendekatan ini mengabstraksikan elemen-elemen penting dari masalah ke dalam sebuah model, yang kemudian dianalisis untuk menghasilkan solusi yang optimal untuk diimplementasikan. Rincian matematika dan teknik khusus yang digunakan untuk membangun dan menganalisis model-model ini dapat menjadi sangat rumit dan dibahas di bagian lain dalam buku ini; penekanan bab ini adalah pada pendekatannya. Tinjauan singkat mengenai asal-usul sejarah O.R. diikuti dengan penjelasan rinci mengenai metodologinya. Bab ini diakhiri dengan beberapa contoh aplikasi O.R. yang sukses di dunia nyata.

1.1 Pendahuluan

Meskipun merupakan disiplin ilmu yang berbeda, Riset Operasi (Operations Research atau OR) juga telah menjadi bagian integral dari profesi Teknik Industri (Industrial Engineering atau IE). Hal ini tidak mengherankan jika kita mempertimbangkan bahwa keduanya memiliki banyak tujuan, teknik, dan area aplikasi yang sama. O.R. sebagai subjek formal berusia sekitar lima puluh tahun dan asal-usulnya dapat ditelusuri hingga paruh kedua Perang Dunia II. Sebagian besar teknik O.R. yang umum digunakan saat ini dikembangkan selama (kurang lebih) dua puluh tahun pertama setelah awal kemunculannya. Selama sekitar tiga puluh tahun berikutnya, laju pengembangan metodologi O.R. yang secara fundamental baru agak melambat. Namun, telah terjadi perluasan yang cepat dalam

- Luasnya area masalah yang telah diterapkan O.R.,

- Besarnya masalah yang dapat ditangani dengan menggunakan metodologi O.R..

Saat ini, riset operasi adalah bidang yang matang dan berkembang dengan baik dengan serangkaian teknik canggih yang digunakan secara rutin untuk memecahkan masalah dalam berbagai bidang aplikasi.

Bab ini akan memberikan gambaran umum tentang O.R. dari sudut pandang seorang Insinyur Industri. Tinjauan singkat tentang asal-usul sejarahnya akan diberikan terlebih dahulu. Ini diikuti dengan diskusi terperinci tentang filosofi dasar di balik O.R. dan apa yang disebut “pendekatan O.R.”. Bab ini diakhiri dengan beberapa contoh aplikasi yang berhasil untuk masalah-masalah umum yang mungkin dihadapi oleh seorang Insinyur Industri. Secara garis besar, proyek O.R. terdiri dari tiga langkah:

- Membangun model.

- Menyelesaikannya.

- Mengimplementasikan hasilnya.

Penekanan bab ini adalah pada langkah pertama dan ketiga. Langkah kedua biasanya melibatkan metodologi atau teknik tertentu, yang bisa jadi cukup canggih dan membutuhkan pengembangan matematika yang signifikan. Beberapa metode penting diulas di bagian lain dalam buku ini. Pembaca yang berminat untuk mempelajari lebih lanjut tentang topik-topik ini dapat merujuk ke salah satu dari sekian banyak teks yang sangat bagus tentang O.R. yang tersedia saat ini dan yang terdaftar di bawah “Bacaan Lebih Lanjut” di akhir bab ini, misalnya, Hillier dan Lieberman (1995), Taha (1997) atau Winston (1994).

1.2 PerspektifSejarah

Meskipun tidak ada tanggal yang jelas yang menandai kelahiran O.R., secara umum diterima bahwa bidang ini berasal dari Inggris selama Perang Dunia II. Dorongan untuk asal-usulnya adalah pengembangan sistem pertahanan radar untuk Angkatan Udara Kerajaan, dan penggunaan pertama kali dari istilah Riset Operasi dikaitkan dengan pejabat Kementerian Udara Inggris bernama A.P. Rowe yang membentuk tim untuk melakukan “penelitian operasional” pada sistem komunikasi dan ruang kontrol di stasiun radar Inggris. Penelitian ini berkaitan dengan peningkatan efisiensi operasional sistem (sebuah tujuan yang masih menjadi salah satu pilar O.R. modern).

Pendekatan baru dalam memilih sistem “operasional” dan melakukan “penelitian” tentang cara membuatnya berjalan lebih efisien segera mulai berkembang ke arena perang lainnya. Mungkin kelompok yang paling terkenal yang terlibat dalam upaya ini adalah kelompok yang dipimpin oleh fisikawan bernama P. M. S. Blackett yang mencakup ahli fisiologi, matematikawan, astrofisikawan, dan bahkan surveyor. Fokus tim multifungsi dari kelompok proyek riset operasi ini adalah salah satu yang terus berlanjut hingga hari ini. Kontribusi terbesar Blackett adalah meyakinkan pihak berwenang tentang perlunya pendekatan ilmiah untuk mengelola operasi yang kompleks, dan memang dia dianggap oleh banyak kalangan sebagai analis riset operasi yang asli.

O.R. masuk ke Amerika Serikat beberapa tahun setelah berasal dari Inggris. Kehadiran pertamanya di AS adalah melalui Kelompok Riset Operasi Perang Ranjau Angkatan Laut AS; yang kemudian berkembang menjadi Kelompok Riset Operasi Perang Antikapal Selam yang dipimpin oleh Phillip Morse, yang kemudian dikenal dengan sebutan Kelompok Riset Operasi. Seperti Blackett di Inggris, Morse secara luas dianggap sebagai “bapak” O.R. di Amerika Serikat, dan banyak ilmuwan dan matematikawan terkemuka yang dia pimpin setelah perang berakhir menjadi pelopor O.R. di Amerika Serikat.

Pada tahun-tahun setelah berakhirnya Perang Dunia II, O.R. berkembang pesat karena banyak ilmuwan menyadari bahwa prinsip-prinsip yang mereka terapkan untuk memecahkan masalah militer juga dapat diterapkan pada banyak masalah di sektor sipil. Mulai dari masalah jangka pendek seperti penjadwalan dan kontrol inventaris hingga masalah jangka panjang seperti perencanaan strategis dan alokasi sumber daya. George Dantzig, yang pada tahun 1947 mengembangkan algoritma simpleks untuk Pemrograman Linier (LP), memberikan dorongan terpenting untuk pertumbuhan ini. Hingga saat ini, LP tetap menjadi salah satu teknik yang paling banyak digunakan dari semua teknik O.R. dan meskipun ada perkembangan yang relatif baru dari metode titik interior sebagai pendekatan alternatif, algoritma simpleks (dengan berbagai penyempurnaan komputasi) terus digunakan secara luas. Dorongan utama kedua untuk pertumbuhan O.R. adalah perkembangan pesat komputer digital selama tiga dekade berikutnya. Metode simpleks diimplementasikan pada komputer untuk pertama kalinya pada tahun 1950, dan pada tahun 1960, implementasi tersebut dapat menyelesaikan masalah dengan sekitar 1000 batasan. Saat ini, implementasi pada workstation yang kuat dapat secara rutin menyelesaikan masalah dengan ratusan ribu variabel dan batasan. Selain itu, volume data yang besar yang diperlukan untuk masalah seperti itu dapat disimpan dan dimanipulasi dengan sangat efisien.

Setelah metode simpleks ditemukan dan digunakan, pengembangan metode lain mengikuti dengan cepat. Dua puluh tahun berikutnya menjadi saksi perkembangan sebagian besar teknik O.R. yang digunakan saat ini termasuk pemrograman nonlinier, bilangan bulat dan dinamis, simulasi komputer, PERT atau CPM, teori antrian, model inventaris, teori permainan, serta algoritma pengurutan dan penjadwalan. Para ilmuwan yang mengembangkan metode-metode ini berasal dari berbagai bidang, terutama matematika, teknik, dan ekonomi. Menariknya, dasar-dasar teori untuk banyak teknik ini telah dikenal selama bertahun-tahun, misalnya, rumus EOQ yang digunakan dengan banyak model inventaris dikembangkan pada tahun 1915 oleh Harris, dan banyak rumus antrian dikembangkan oleh Erlang pada tahun 1917. Namun, periode dari tahun 1950 hingga 1970 adalah saat rumus-rumus tersebut secara resmi disatukan ke dalam apa yang dianggap sebagai perangkat standar untuk analis riset operasi dan berhasil diterapkan pada masalah-masalah yang penting bagi industri. Bagian berikut ini menjelaskan pendekatan yang diambil oleh riset operasi untuk memecahkan masalah dan mengeksplorasi bagaimana semua metodologi ini cocok dengan kerangka kerja O.R.

1.3 Apa Itu Riset Oprasi?

Kesalahpahaman umum yang dipegang oleh banyak orang adalah bahwa O.R. adalah kumpulan alat matematika. Meskipun benar bahwa O.R. menggunakan berbagai teknik matematika, riset operasi memiliki cakupan yang lebih luas. Riset operasi sebenarnya adalah pendekatan sistematis untuk memecahkan masalah, yang menggunakan satu atau lebih alat analisis dalam proses analisis. Mungkin satu-satunya masalah terbesar dengan O.R. adalah namanya; bagi orang awam, istilah “riset operasi” tidak memunculkan gambaran yang berarti! Ini adalah konsekuensi yang tidak menguntungkan dari fakta bahwa nama yang dikreditkan oleh A.P. Rowe yang pertama kali diberikan kepada bidang ini entah bagaimana tidak pernah diubah menjadi sesuatu yang lebih menunjukkan hal-hal yang sebenarnya dilakukan oleh O.R..

Kadang-kadang O.R. disebut sebagai Ilmu Manajemen (Management Science, M.S.) untuk lebih mencerminkan perannya sebagai pendekatan ilmiah untuk memecahkan masalah manajemen, tetapi tampaknya terminologi ini lebih populer di kalangan profesional bisnis dan orang-orang masih berdalih tentang perbedaan antara O.R. dan M.S. Yang memperparah masalah ini adalah kenyataan bahwa tidak ada konsensus yang jelas tentang definisi formal untuk O.R. Misalnya, C.W. Churchman yang dianggap sebagai salah satu pelopor O.R. mendefinisikannya sebagai penerapan metode, teknik, dan alat ilmiah untuk masalah-masalah yang melibatkan operasi suatu sistem sehingga dapat memberikan mereka yang memegang kendali atas sistem tersebut dengan solusi yang optimal untuk masalah-masalah tersebut.

Ini memang definisi yang cukup komprehensif, tetapi ada banyak orang lain yang cenderung ke arah yang lebih ekstrem dan mendefinisikan riset operasi sebagai apa yang dilakukan oleh para peneliti operasi (definisi yang tampaknya paling sering dikaitkan dengan E. Naddor)! Terlepas dari kata-kata yang digunakan, mungkin aman untuk mengatakan bahwa julukan “riset operasi” akan terus digunakan dan oleh karena itu penting untuk memahami bahwa pada intinya, O.R. dapat dilihat sebagai pendekatan sistematis dan analitis untuk pengambilan keputusan dan pemecahan masalah. Kuncinya di sini adalah bahwa O.R. menggunakan metodologi yang obyektif dan diartikulasikan dengan jelas, dan dibangun berdasarkan filosofi bahwa pendekatan semacam itu lebih unggul daripada pendekatan yang hanya didasarkan pada subjektivitas dan pendapat “para ahli”, karena pendekatan ini akan menghasilkan keputusan yang lebih baik dan konsisten.

Namun, O.R. tidak menghalangi penggunaan penilaian manusia atau penalaran yang tidak dapat dikuantifikasi; sebaliknya, hal tersebut dipandang sebagai pelengkap dari pendekatan analitis. Oleh karena itu, kita harus melihat O.R. bukan sebagai proses pengambilan keputusan yang absolut, tetapi sebagai alat bantu untuk membuat keputusan yang baik. O.R. memainkan peran sebagai penasihat dengan memberikan manajer atau pengambil keputusan dengan serangkaian alternatif yang baik dan ilmiah. Namun, keputusan akhir selalu diserahkan kepada manusia yang memiliki pengetahuan yang tidak dapat diukur secara tepat, dan yang dapat menyesuaikan hasil analisis untuk mendapatkan keputusan yang masuk akal.

Disadur dari: sites.pitt.edu

Teknik Industri

Model dalam Riset Operasi: Sebuah Tinjauan Komprehensif

Dipublikasikan oleh Anjas Mifta Huda pada 10 Februari 2025

Model fisik: Model ini merupakan versi aktual yang diperkecil dari model aslinya. Contohnya termasuk bola dunia, model mobil berskala, atau model garis aliran yang dibuat dengan elemen-elemen dari perangkat konstruksi mainan. Secara umum, model-model seperti ini tidak terlalu umum dalam riset operasi, terutama karena mendapatkan representasi yang akurat dari sistem yang kompleks melalui model fisik sering kali tidak mungkin.

Model analog: Ini adalah model yang merupakan langkah mundur dari kategori pertama karena mereka juga merupakan model fisik, tetapi menggunakan analog fisik untuk menggambarkan sistem, bukan versi yang diperkecil. Mungkin contoh paling terkenal dari model analog adalah model ANTIAC (singkatan dari anti-automatic-computation) yang menunjukkan bahwa seseorang dapat melakukan analisis riset operasi yang valid tanpa menggunakan komputer. Dalam masalah ini, tujuannya adalah untuk menemukan cara terbaik untuk mendistribusikan pasokan di depot militer ke berbagai titik permintaan. Masalah seperti ini dapat diselesaikan secara efisien dengan menggunakan teknik-teknik dari analisis aliran jaringan.

Namun prosedur aktual yang digunakan menggunakan pendekatan yang berbeda. Sarang semut di atas platform yang ditinggikan dipilih sebagai analogi untuk depot dan gundukan kecil gula di platform masing-masing dipilih untuk mewakili setiap titik permintaan. Jaringan jalan yang menghubungkan berbagai titik tersebut dibangun dengan menggunakan potongan-potongan tali dengan panjang masing-masing proporsional dengan jarak yang sebenarnya dan lebarnya sesuai dengan kapasitas di sepanjang jalur tersebut. Sepasukan semut kemudian dilepaskan di sarang semut dan jalur yang mereka pilih untuk mencapai gundukan gula kemudian diamati. Setelah model mencapai kondisi tunak, ditemukan bahwa semut-semut tersebut berdasarkan kecenderungan mereka sendiri telah menemukan jalur yang paling efisien ke tujuan mereka! Kita bahkan dapat melakukan beberapa analisis postoptimality.

Sebagai contoh, berbagai kapasitas transportasi di sepanjang setiap jalur dapat dianalisis dengan memvariasikan lebar jalur secara proporsional, dan skenario di mana jalur tertentu tidak dapat digunakan dapat dianalisis hanya dengan menghapus jalur yang sesuai untuk melihat apa yang semut akan lakukan. Hal ini mengilustrasikan sebuah model analog. Lebih penting lagi, hal ini juga menggambarkan bahwa meskipun O.R. biasanya diidentikkan dengan analisis matematis, penggunaan model inovatif dan prosedur pemecahan masalah seperti yang baru saja dijelaskan merupakan cara yang sah untuk melakukan studi O.R..

Model simulasi komputer: Dengan pertumbuhan daya komputasi, model-model ini telah menjadi sangat populer selama sepuluh hingga lima belas tahun terakhir. Model simulasi adalah model di mana sistem diabstraksikan ke dalam program komputer. Meskipun bahasa komputer tertentu yang digunakan bukanlah karakteristik yang menentukan, sejumlah bahasa dan sistem perangkat lunak telah dikembangkan semata-mata untuk tujuan membangun model simulasi komputer; sebuah survei tentang sistem yang paling populer dapat ditemukan di OR atau MS Today (Oktober 1997, hal. 38-46). Biasanya, perangkat lunak semacam itu memiliki sintaks serta konstruksi bawaan yang memungkinkan pengembangan model yang mudah.

Sering kali mereka juga memiliki ketentuan untuk grafik dan animasi yang dapat membantu seseorang memvisualisasikan sistem yang sedang disimulasikan. Model simulasi dianalisis dengan menjalankan perangkat lunak selama beberapa waktu yang mewakili periode yang sesuai ketika sistem asli beroperasi dalam kondisi tunak. Input untuk model tersebut adalah variabel keputusan yang berada di bawah kendali pengambil keputusan. Variabel-variabel tersebut diperlakukan sebagai parameter dan simulasi dijalankan untuk berbagai kombinasi nilai untuk parameter-parameter tersebut. Pada akhir simulasi, statistik dikumpulkan untuk berbagai ukuran kinerja dan kemudian dianalisis dengan menggunakan teknik standar. Pengambil keputusan kemudian memilih kombinasi nilai untuk variabel keputusan yang menghasilkan kinerja yang paling diinginkan.

Model simulasi sangat kuat dan memiliki satu fitur yang sangat diinginkan: model ini dapat digunakan untuk memodelkan sistem yang sangat kompleks tanpa perlu membuat terlalu banyak asumsi penyederhanaan dan tanpa perlu mengorbankan detail. Di sisi lain, kita harus sangat berhati-hati dengan model simulasi karena simulasi juga mudah disalahgunakan.

- Pertama, sebelum menggunakan model, model tersebut harus divalidasi dengan benar. Meskipun validasi diperlukan untuk model apa pun, validasi sangat penting dalam simulasi.

- Kedua, analis harus terbiasa dengan cara menggunakan model simulasi dengan benar, termasuk hal-hal seperti replikasi, run length, pemanasan, dan sebagainya; penjelasan rinci mengenai konsep-konsep ini berada di luar cakupan bab ini, namun pembaca yang tertarik dapat merujuk pada teks yang baik mengenai simulasi.

- Ketiga, analis harus terbiasa dengan berbagai teknik statistik agar dapat menganalisis hasil simulasi dengan cara yang bermakna.

- Keempat, membangun model simulasi yang kompleks pada komputer sering kali merupakan tugas yang menantang dan relatif memakan waktu, meskipun perangkat lunak simulasi telah berkembang hingga menjadi lebih mudah dari hari ke hari. Alasan mengapa masalah ini ditekankan di sini adalah karena model simulasi modern dapat terlihat sangat mencolok dan menarik, tetapi nilai sebenarnya terletak pada kemampuannya untuk menghasilkan wawasan ke dalam masalah yang sangat kompleks. Namun demikian, untuk mendapatkan wawasan semacam itu, diperlukan keterampilan teknis yang cukup tinggi.

Hal terakhir yang perlu diingat dengan simulasi adalah bahwa simulasi tidak memberikan indikasi strategi yang optimal. Dalam beberapa hal, ini adalah proses coba-coba karena seseorang bereksperimen dengan berbagai strategi yang tampaknya masuk akal dan melihat hasil obyektif yang diberikan oleh model simulasi untuk mengevaluasi manfaat dari setiap strategi. Jika jumlah variabel keputusan sangat banyak, maka seseorang harus membatasi diri pada beberapa bagian dari variabel-variabel tersebut untuk dianalisis, dan ada kemungkinan bahwa strategi akhir yang dipilih bukanlah strategi yang optimal. Namun, dari sudut pandang praktisi, tujuannya sering kali adalah untuk menemukan strategi yang baik dan bukan yang terbaik, dan model simulasi sangat berguna dalam memberikan solusi yang baik bagi pengambil keputusan.

Model matematika: Ini adalah kategori model terakhir, dan yang secara tradisional paling sering diidentikkan dengan O.R. Dalam jenis model ini, seseorang menangkap karakteristik suatu sistem atau proses melalui serangkaian hubungan matematis. Model matematis dapat bersifat deterministik atau probabilistik. Pada jenis yang pertama, semua parameter yang digunakan untuk menggambarkan model diasumsikan diketahui (atau diestimasi dengan tingkat kepastian yang tinggi). Pada model probabilistik, nilai pasti untuk beberapa parameter mungkin tidak diketahui, namun diasumsikan bahwa parameter tersebut dapat dikarakterisasi dengan cara yang sistematis (misalnya, melalui penggunaan distribusi probabilitas).

Sebagai ilustrasi, Metode Jalur Kritis (CPM) dan Teknik Evaluasi dan Peninjauan Program (PERT) adalah dua teknik O.R. yang sangat mirip yang digunakan dalam bidang perencanaan proyek. Namun, CPM didasarkan pada model matematika deterministik yang mengasumsikan bahwa durasi setiap aktivitas proyek adalah konstanta yang diketahui, sedangkan PERT didasarkan pada model probabilistik yang mengasumsikan bahwa setiap durasi aktivitas bersifat acak tetapi mengikuti beberapa distribusi probabilitas tertentu (biasanya, distribusi Beta). Secara garis besar, model deterministik cenderung lebih mudah dianalisis daripada model probabilistik; namun, hal ini tidak berlaku secara universal.

Sebagian besar model matematika cenderung dicirikan oleh tiga elemen utama: variabel keputusan, batasan, dan fungsi objektif. Variabel keputusan digunakan untuk memodelkan tindakan spesifik yang berada di bawah kendali pengambil keputusan. Analisis model akan mencari nilai spesifik untuk variabel-variabel ini yang diinginkan dari satu atau beberapa perspektif. Sering kali - terutama pada model yang besar - juga umum untuk mendefinisikan variabel “kenyamanan” tambahan untuk tujuan menyederhanakan model atau membuatnya lebih jelas. Sebenarnya, variabel-variabel tersebut tidak berada di bawah kendali pengambil keputusan, tetapi juga disebut sebagai variabel keputusan. Kendala digunakan untuk menetapkan batasan pada rentang nilai yang dapat diambil oleh setiap variabel keputusan, dan setiap kendala biasanya merupakan terjemahan dari beberapa batasan tertentu (misalnya, ketersediaan sumber daya) atau persyaratan (misalnya, kebutuhan untuk memenuhi permintaan yang telah dikontrak).

Jelasnya, batasan menentukan nilai yang dapat diberikan pada variabel keputusan, yaitu keputusan spesifik pada sistem atau proses yang dapat diambil. Komponen ketiga dan terakhir dari model matematika adalah fungsi tujuan. Ini adalah pernyataan matematis dari beberapa ukuran kinerja (seperti biaya, keuntungan, waktu, pendapatan, pemanfaatan, dll.) dan dinyatakan sebagai fungsi dari variabel keputusan untuk model. Biasanya diinginkan untuk memaksimalkan atau meminimalkan nilai fungsi tujuan, tergantung pada apa yang diwakilinya. Sering kali, seseorang mungkin secara bersamaan memiliki lebih dari satu fungsi objektif untuk dioptimalkan (misalnya, memaksimalkan keuntungan dan meminimalkan perubahan tingkat tenaga kerja).

Dalam kasus seperti ini, ada dua pilihan. Pertama, kita dapat fokus pada satu tujuan dan menurunkan tujuan yang lain ke status sekunder dengan memindahkannya ke dalam himpunan batasan dan menentukan nilai minimum atau maksimum yang diinginkan. Ini cenderung menjadi pilihan yang lebih sederhana dan yang paling sering digunakan. Pilihan lainnya adalah dengan menggunakan teknik yang dirancang khusus untuk beberapa tujuan (seperti goal programming).

Dalam menggunakan model matematika, idenya adalah pertama-tama menangkap semua aspek penting dari sistem dengan menggunakan tiga elemen yang baru saja dijelaskan, dan kemudian mengoptimalkan fungsi tujuan dengan memilih (dari semua nilai untuk variabel keputusan yang tidak melanggar batasan yang ditentukan) nilai spesifik yang juga menghasilkan nilai yang paling diinginkan (maksimum atau minimum) untuk fungsi tujuan. Proses ini sering disebut pemrograman matematis. Meskipun banyak model matematis cenderung mengikuti bentuk ini, hal ini tentu saja tidak menjadi keharusan; sebagai contoh, sebuah model dapat dibuat untuk mendefinisikan hubungan antara beberapa variabel dan pengambil keputusan dapat menggunakan model ini untuk mempelajari bagaimana satu atau beberapa variabel terpengaruh oleh perubahan nilai variabel lainnya. Pohon keputusan, rantai Markov, dan banyak model antrian dapat dimasukkan ke dalam kategori ini.

Sebelum mengakhiri bagian formulasi model ini, kita kembali ke contoh hipotetis dan menerjemahkan pernyataan yang dibuat pada tahap pendefinisian masalah ke dalam model matematika dengan menggunakan informasi yang dikumpulkan pada tahap pengumpulan data. Untuk melakukan hal ini, kami mendefinisikan dua variabel keputusan G dan W untuk mewakili jumlah gizmos dan widget yang akan dibuat dan dijual bulan depan. Kemudian tujuannya adalah untuk memaksimalkan keuntungan total yang diberikan oleh 10G + 9W. Ada kendala yang terkait dengan masing-masing dari tiga sumber daya terbatas, yang harus memastikan bahwa

Produksi G gizmos dan W widget tidak menggunakan lebih banyak sumber daya yang sesuai daripada yang tersedia untuk digunakan. Jadi untuk sumber daya 1, hal ini akan diterjemahkan ke dalam pernyataan matematika berikut ini 0,7G + 1,0W ≤ 630, di mana sisi kiri pertidaksamaan menunjukkan penggunaan sumber daya dan sisi kanan menunjukkan ketersediaan sumber daya. Selain itu, kita juga harus memastikan bahwa setiap nilai G dan W yang dipertimbangkan adalah bilangan bulat non-negatif, karena nilai lainnya tidak ada artinya dalam definisi G dan W. Model matematis lengkapnya adalah:

- Maksimalkan {Laba = 10G + 9W}, dengan syarat

- 0,7G + 1,0W ≤ 630

- 1.0G + (2/3) W ≤ 708

- 0,1G + 0,25W ≤ 135

- G, W ≥ 0 dan bilangan bulat.

Program matematika ini mencoba memaksimalkan keuntungan sebagai fungsi dari jumlah produksi (G dan W), sambil memastikan bahwa jumlah tersebut sedemikian rupa sehingga produksi yang sesuai dapat dilakukan dengan sumber daya yang tersedia.

Solusi model: Fase kelima dari proses O.R. adalah solusi dari masalah yang diwakili oleh model. Ini adalah area di mana sejumlah besar penelitian dan pengembangan di bidang O.R. telah difokuskan, dan ada banyak sekali metode untuk menganalisis berbagai macam model. Tidak mungkin untuk membahas secara rinci berbagai teknik ini dalam satu bab pengantar seperti ini; namun, gambaran umum dari beberapa metode yang lebih penting dapat ditemukan di bagian lain dalam buku ini. Secara umum, beberapa pelatihan formal dalam riset operasi diperlukan untuk memahami bagaimana metode-metode ini bekerja dan pembaca yang tertarik disarankan untuk membaca dengan seksama teks pengantar tentang O.R.; bagian “Bacaan Lebih Lanjut” pada akhir bab ini mencantumkan beberapa buku yang bagus.

Perlu juga disebutkan bahwa dalam beberapa tahun terakhir ini sejumlah sistem perangkat lunak telah muncul yang (setidaknya secara teori) merupakan “kotak hitam” untuk memecahkan berbagai model. Namun, beberapa pendidikan formal dalam metode O.R. masih diperlukan (atau setidaknya sangat disarankan) sebelum menggunakan sistem tersebut. Dari sudut pandang praktisi, hal yang paling penting adalah untuk dapat mengenali mana dari sekian banyak teknik yang tersedia yang sesuai untuk model yang dibangun. Biasanya, hal ini bukanlah tugas yang sulit bagi seseorang yang memiliki pelatihan dasar dalam riset operasi. Teknik-teknik itu sendiri terbagi dalam beberapa kategori.

Pada tingkat yang paling rendah, seseorang mungkin dapat menggunakan teknik grafis sederhana atau bahkan mencoba-coba. Namun, terlepas dari kenyataan bahwa perkembangan spreadsheet telah membuat hal ini jauh lebih mudah dilakukan, ini biasanya merupakan pendekatan yang tidak dapat dilakukan untuk sebagian besar masalah yang tidak sepele. Sebagian besar teknik O.R. bersifat analitis, dan masuk ke dalam salah satu dari empat kategori besar. Pertama, ada teknik simulasi, yang jelas digunakan untuk menganalisis model simulasi. Sebagian besar dari teknik ini adalah program komputer yang menjalankan model dan metode yang digunakan untuk melakukannya dengan benar.

Namun, bagian yang lebih menarik dan menantang adalah teknik yang digunakan untuk menganalisis volume output yang besar dari program-program tersebut; biasanya, hal ini mencakup sejumlah teknik statistik. Pembaca yang tertarik dapat merujuk pada buku yang bagus tentang simulasi untuk melihat bagaimana kedua bagian ini saling melengkapi. Kategori kedua terdiri dari teknik-teknik analisis matematis yang digunakan untuk menangani model yang tidak memiliki fungsi tujuan atau batasan yang jelas, namun merupakan representasi matematis dari sistem yang dimaksud.

Contohnya termasuk teknik statistik umum seperti analisis regresi, inferensi statistik dan analisis varians, serta yang lainnya seperti antrian, rantai Markov dan analisis keputusan. Kategori ketiga terdiri dari teknik pencarian optimal, yang biasanya digunakan untuk menyelesaikan program matematika yang dijelaskan di bagian sebelumnya untuk menemukan nilai optimal (yaitu, terbaik) untuk variabel keputusan. Teknik-teknik spesifik termasuk pemrograman linier, nonlinier, dinamis, bilangan bulat, tujuan, dan stokastik, serta berbagai metode berbasis jaringan. Penjelasan rinci mengenai hal ini berada di luar cakupan bab ini, tetapi ada sejumlah teks yang sangat baik dalam pemrograman matematika yang menjelaskan banyak metode ini dan pembaca yang tertarik dapat merujuk ke salah satunya. Kategori terakhir dari teknik-teknik ini sering disebut sebagai heuristik.

Ciri khas dari teknik heuristik adalah bahwa teknik ini tidak menjamin bahwa solusi terbaik akan ditemukan, tetapi pada saat yang sama tidak serumit teknik pencarian optimal. Meskipun heuristik dapat berupa teknik yang sederhana, masuk akal, dan bersifat rule-of-thumb, teknik ini biasanya merupakan metode yang mengeksploitasi fitur-fitur masalah tertentu untuk mendapatkan hasil yang baik. Perkembangan yang relatif baru di bidang ini adalah apa yang disebut meta-heuristik (seperti algoritme genetika, pencarian tabu, pemrograman evolusioner, dan simulated annealing) yang merupakan metode tujuan umum yang dapat diterapkan pada sejumlah masalah yang berbeda. Metode-metode ini secara khusus semakin populer karena kesederhanaannya yang relatif dan fakta bahwa peningkatan daya komputasi telah meningkatkan efektivitasnya.

Dalam menerapkan teknik tertentu, hal yang penting untuk diingat dari sudut pandang praktisi adalah bahwa teknik tersebut sering kali cukup untuk mendapatkan solusi yang baik meskipun tidak dijamin sebagai solusi terbaik. Jika ketersediaan sumber daya maupun waktu tidak menjadi masalah, tentu saja seseorang akan mencari solusi yang optimal. Namun, hal ini jarang terjadi dalam praktiknya, dan ketepatan waktu merupakan hal yang penting dalam banyak kasus. Dalam konteks ini, sering kali lebih penting untuk mendapatkan solusi yang memuaskan dengan cepat daripada mengeluarkan banyak usaha untuk menentukan solusi yang optimal, terutama ketika keuntungan marjinal dari hal tersebut kecil. Ekonom Herbert Simon menggunakan istilah “memuaskan” untuk menggambarkan konsep ini - seseorang mencari yang optimal tetapi berhenti di tengah jalan ketika solusi yang cukup baik telah ditemukan.

Pada titik ini, beberapa kata tentang aspek komputasi sudah sesuai. Ketika diterapkan pada masalah dunia nyata yang tidak sepele, hampir semua teknik yang dibahas dalam bagian ini memerlukan penggunaan komputer. Memang, dorongan terbesar untuk peningkatan penggunaan metode O.R. adalah peningkatan yang cepat dalam daya komputasi. Meskipun masih ada masalah skala besar yang solusinya membutuhkan penggunaan komputer mainframe atau workstation yang kuat, banyak masalah besar saat ini yang dapat diselesaikan pada sistem komputer mikro desktop.

Ada banyak paket komputer (dan jumlahnya terus bertambah dari hari ke hari) yang telah menjadi populer karena kemudahan penggunaannya dan biasanya tersedia dalam berbagai versi atau ukuran dan antarmuka yang mulus dengan sistem perangkat lunak lain; tergantung pada kebutuhan spesifik mereka, pengguna akhir dapat memilih konfigurasi yang sesuai. Banyak vendor perangkat lunak juga menawarkan layanan pelatihan dan konsultasi untuk membantu pengguna mendapatkan hasil maksimal dari sistem. Beberapa teknik khusus yang tersedia untuk implementasi perangkat lunak komersial saat ini termasuk optimasi/pemrograman matematis (termasuk pemrograman linier, nonlinier, bilangan bulat, dinamis, dan tujuan), aliran jaringan, simulasi, analisis statistik, antrian, peramalan, jaringan syaraf tiruan, analisis keputusan, dan PERT / CPM. Saat ini juga tersedia sistem perangkat lunak komersial yang menggabungkan berbagai teknik O.R. untuk menangani area aplikasi spesifik termasuk transportasi dan logistik, perencanaan produksi, kontrol inventaris, penjadwalan, analisis lokasi, peramalan, dan manajemen rantai pasokan. Beberapa contoh sistem perangkat lunak O.R. yang populer antara lain CPLEX, LINDO, OSL, MPL, SAS, dan SIMAN.

Meskipun jelas tidak mungkin untuk menjelaskan di sini fitur-fitur dari semua perangkat lunak yang tersedia, majalah seperti OR/MS Today dan IE Solutions secara teratur menerbitkan survei terpisah dari berbagai kategori sistem dan paket perangkat lunak. Publikasi-publikasi ini juga menyediakan petunjuk untuk berbagai jenis perangkat lunak yang tersedia; sebagai contoh, OR/MS Today edisi Desember 1997 (halaman 61-75) menyediakan direktori sumber daya yang lengkap untuk perangkat lunak dan konsultan. Pembaruan untuk direktori tersebut disediakan secara berkala. Poin utama di sini adalah bahwa kemampuan untuk memecahkan model/masalah yang kompleks jauh lebih sedikit menjadi masalah saat ini dibandingkan satu atau dua dekade yang lalu, dan ada banyak sumber daya yang tersedia untuk mengatasi masalah ini.

Kami menyimpulkan bagian ini dengan memeriksa solusi dari model yang telah dibuat sebelumnya untuk masalah produksi hipotetis. Menggunakan pemrograman linier untuk menyelesaikan model ini menghasilkan solusi optimal G = 540 dan W = 252, yaitu rencana produksi yang memaksimalkan keuntungan untuk data yang diberikan membutuhkan produksi 540 gawai dan 252 widget. Pembaca dapat dengan mudah memverifikasi bahwa hal ini menghasilkan keuntungan sebesar $7668 dan sepenuhnya menggunakan dua sumber daya pertama dan menyisakan 18 unit sumber daya terakhir yang tidak terpakai.

Perhatikan bahwa solusi ini tentu saja tidak jelas dengan hanya melihat model matematisnya - pada kenyataannya, jika seseorang “serakah” dan mencoba membuat sebanyak mungkin gizmos (karena menghasilkan keuntungan yang lebih tinggi per unit daripada widget), ini akan menghasilkan G = 708 dan W = 0 (di mana pada titik ini semua sumber daya kedua habis terpakai). Namun, keuntungan yang dihasilkan sebesar $7080 adalah sekitar 8% lebih kecil dari yang diperoleh melalui rencana optimal. Alasannya tentu saja karena rencana ini tidak memanfaatkan sumber daya yang tersedia secara efektif dan tidak memperhitungkan interaksi antara keuntungan dan pemanfaatan sumber daya. Meskipun perbedaan yang sebenarnya kecil untuk contoh hipotetis ini, manfaat menggunakan teknik O.R. yang baik dapat menghasilkan perbaikan yang sangat signifikan untuk masalah dunia nyata yang besar.

Validasi dan analisis: Setelah solusi diperoleh, ada dua hal yang perlu dilakukan sebelum seseorang mempertimbangkan untuk mengembangkan kebijakan akhir atau tindakan untuk implementasi. Yang pertama adalah memverifikasi bahwa solusi itu sendiri masuk akal. Seringkali, hal ini tidak terjadi dan alasan yang paling umum adalah bahwa model yang digunakan tidak akurat atau tidak menangkap beberapa masalah utama. Proses untuk memastikan bahwa model tersebut merupakan representasi yang akurat dari sistem disebut validasi dan ini adalah sesuatu yang (jika memungkinkan) harus dilakukan sebelum solusi yang sebenarnya.

Namun, terkadang perlu untuk menyelesaikan model untuk menemukan ketidakakuratan di dalamnya. Kesalahan umum yang mungkin ditemukan pada tahap ini adalah bahwa beberapa kendala penting diabaikan dalam formulasi model - ini akan mengarah pada solusi yang secara jelas dikenali sebagai tidak dapat dilakukan dan analis kemudian harus kembali dan memodifikasi model dan menyelesaikannya kembali. Siklus ini terus berlanjut sampai kita yakin bahwa hasilnya masuk akal dan berasal dari representasi sistem yang valid.

Bagian kedua dari langkah ini dalam proses O.R. disebut sebagai analisis postoptimality, atau dalam istilah awam, analisis “bagaimana-jika”. Ingatlah bahwa model yang menjadi dasar dari solusi yang diperoleh adalah (a) abstraksi selektif dari sistem asli, dan (b) dibangun dengan menggunakan data yang dalam banyak kasus tidak 100% akurat. Karena validitas solusi yang diperoleh dibatasi oleh keakuratan model, pertanyaan alami yang menarik bagi seorang analis adalah:

“Seberapa kuatkah solusi yang diperoleh sehubungan dengan penyimpangan dalam asumsi yang melekat pada model dan nilai parameter yang digunakan untuk membangunnya?”

Untuk mengilustrasikan hal ini dengan masalah produksi hipotetis kita, contoh beberapa pertanyaan yang mungkin ingin ditanyakan oleh seorang analis adalah:

- (a) “Akankah rencana produksi optimal berubah jika keuntungan yang terkait dengan widget ditaksir terlalu tinggi sebesar 5%, dan jika ya, bagaimana caranya?” atau

- (b) “Jika sejumlah tambahan Sumber Daya 2 dapat dibeli dengan harga premium, apakah layak dibeli dan jika ya, berapa banyak?” atau

- (c) “Jika ketidakandalan mesin mengurangi ketersediaan Sumber Daya 3 sebesar 8%, apa pengaruhnya terhadap kebijakan optimal?” Pertanyaan-pertanyaan seperti itu sangat menarik bagi para manajer dan pengambil keputusan yang hidup di dunia yang penuh ketidakpastian, dan salah satu aspek terpenting dari proyek O.R. yang baik adalah kemampuan untuk menyediakan tidak hanya tindakan yang direkomendasikan, tetapi juga rincian tentang jangkauan penerapannya dan sensitivitasnya terhadap parameter model.

Sebelum mengakhiri bagian ini, perlu ditekankan bahwa mirip dengan proyek Teknik Industri tradisional, hasil akhir dari proyek O.R. bukanlah solusi pasti untuk suatu masalah. Sebaliknya, ini adalah jawaban obyektif untuk pertanyaan yang diajukan oleh masalah dan yang menempatkan pengambil keputusan di “lapangan bola” yang benar. Oleh karena itu, sangat penting untuk menyelaraskan solusi analitis yang diperoleh dengan akal sehat dan penalaran subjektif sebelum menyelesaikan rencana implementasi. Dari sudut pandang praktisi, rencana yang baik, masuk akal dan dapat diterapkan jauh lebih diinginkan daripada peningkatan bertahap dalam kualitas solusi yang diperoleh. Ini adalah penekanan dari fase kedua dari belakang dari proses O.R. ini.

Implementasi dan pemantauan: Langkah terakhir dalam proses O.R. adalah mengimplementasikan rekomendasi akhir dan membangun kontrol terhadapnya. Implementasi memerlukan pembentukan sebuah tim yang kepemimpinannya terdiri dari beberapa anggota tim O.R. yang asli. Tim ini biasanya bertanggung jawab untuk mengembangkan prosedur operasi atau manual dan jadwal waktu untuk menerapkan rencana tersebut. Setelah implementasi selesai, tanggung jawab untuk memantau sistem biasanya diserahkan kepada tim operasional. Dari perspektif O.R., tanggung jawab utama tim operasi adalah untuk mengakui bahwa hasil yang diimplementasikan hanya valid selama lingkungan operasi tidak berubah dan asumsi yang dibuat oleh penelitian tetap valid.

Jadi, ketika ada penyimpangan radikal dari dasar yang digunakan untuk mengembangkan rencana, seseorang harus mempertimbangkan kembali strateginya. Sebagai contoh sederhana dalam masalah produksi, jika pemogokan mendadak oleh tenaga kerja menyebabkan penurunan drastis dalam ketersediaan tenaga kerja (Sumber Daya 1, misalnya), maka kita harus mempertimbangkan kembali rencana tersebut secara menyeluruh untuk mendapatkan tindakan alternatif. Sebagai kata terakhir tentang implementasi, harus ditekankan bahwa tanggung jawab utama analis riset operasi adalah menyampaikan hasil proyek kepada manajemen dengan cara yang efektif.

Hal ini adalah sesuatu yang sayangnya tidak cukup ditekankan, dan ada banyak contoh studi yang sukses tidak diimplementasikan karena rincian dan manfaatnya tidak disampaikan secara efektif kepada manajemen. Meskipun hal ini tentu saja berlaku untuk setiap proyek secara umum, hal ini sangat penting dalam O.R. karena konten matematisnya dan potensinya untuk tidak sepenuhnya dipahami oleh manajer tanpa latar belakang kuantitatif yang kuat.

Disadur dari: sites.pitt.edu

Teknik Industri

Mengenal Predictive Maintenance dalam Pengelolaan Aset Produksi

Dipublikasikan oleh Anjas Mifta Huda pada 10 Februari 2025

Dalam sebuah industri, bagian terpenting yang mempengaruhi pengelolaan proses produksi yang lancar adalah mesin. Itu sebabnya, pengelolaan aset, terutama mesin, tidak boleh terlewatkan eksistensinya dalam sebuah industri. Mesin juga harus rutin menjalani pemeliharaan atau maintenance. Salah satu metode pemeliharaan mesin dalam sebuah industri adalah Predictive Maintenance.

Key Takeaways

- Predictive maintenance adalah metode pemeliharaan yang didasarkan pada prediksi kerusakan atau kegagalan mesin sebelum terjadi.

- Penggunaan teknologi-teknologi yang tepat dan canggih di atas membentuk fondasi yang kuat untuk implementasi prediktif pemeliharaan

- Tujuan sebuah industri menggunakan metode prediktif ini adalah agar perusahaan industri dapat memperbaiki atau mengganti komponen yang rusak sebelum terjadi kegagalan yang signifikan dan mempengaruhi produktivitas dan efisiensi operasi.

- Manfaat implementasi predictive maintenance dalam sebuah industri dapat menghemat biaya perbaikan yang mahal, meningkatkan waktu operasional mesin yang lebih lama, meningkatkan keselamatan kerja, dan mengurangi risiko kecelakaan di tempat kerja.

Pentingnya kegiatan pemeliharaan dan perawatan pada peralatan produksi atau mesin dalam sebuah industri, terdapat 4 jenis maintenance yang sering digunakan dalam industri, yaitu preventive maintenance atau perawatan pencegahan, predictive maintenance atau perawatan prediksi, breakdown maintenance atau jenis perawatan pemeliharaan yang dilakukan ketika terjadi kerusakan yang tidak terduga, dan corrective maintenance atau perawatan yang dilakukan dengan penggantian komponen rusak.

Namun, pada artikel kali ini yang akan dibahas lebih lanjut adalah mengenai apa itu predictive maintenance dan bagaimana implementasinya dalam pengelolaan aset dan proses produksi industri.

Pengertian Predictive Maintenance

Dilansir dari artikel karya Saeid Mokhatab, William A. Poe dan John Y. Mak yang diakses melalui ScienceDirect, Predictive maintenance atau pemeliharaan prediktif adalah metode di mana masa pakai barang atau suku cadang penting diprediksi berdasarkan inspeksi atau diagnosis untuk menentukan batas masa pakainya. Dibandingkan dengan pemeliharaan berkala, pemeliharaan prediktif adalah pemeliharaan aset (asset management) berbasis kondisi. Metode ini mengelola nilai tren, dengan mengukur dan menganalisis data tentang kerusakan dan menggunakan sistem pengawasan yang dirancang untuk memantau kondisi melalui sistem on-line.

Dengan menggunakan program pemeliharaan prediktif, perusahaan industri dapat memperbaiki atau mengganti komponen yang rusak sebelum terjadi kegagalan yang signifikan (just in time), yang dapat mempengaruhi produktivitas dan efisiensi operasi. Dalam jangka panjang, hal ini terbukti dapat menghemat biaya dan waktu perbaikan yang mahal dan meningkatkan operasional mesin dengan jangka waktu yang lebih lama. Maintenance ini juga dapat meningkatkan keselamatan kerja dan mengurangi risiko kecelakaan di tempat kerja.

Untuk mengimplementasikan program perawatan prediktif, perusahaan industri harus memiliki infrastruktur teknologi dan tim yang terlatih untuk mengumpulkan dan menganalisis data yang diperlukan. Ini termasuk penggunaan sensor, alat pemantauan dan pemrosesan data, serta pemahaman yang kuat tentang bagaimana mesin bekerja dan bagaimana mesin dapat terus ditingkatkan pemanfaatannya.

Implementasi metode perawatan ini juga memerlukan investasi yang signifikan dalam hal monitoring mesin dan sistem yang tepat untuk mengumpulkan dan menganalisis data. Namun, dengan menerapkan metode ini, seharusnya industri dapat meningkatkan efisiensi, memperpanjang masa pakai mesin, dan menghindari biaya perbaikan yang mahal dan waktu henti yang tidak terduga.

Manfaat Pemeliharaan Prediktif bagi Industri

Metode predictive menggunakan metode perawatan berbasis data yang menggunakan teknik analisis dan machine learning untuk memprediksi kapan suatu peralatan berkemungkinan mengalami kerusakan.

Dengan menganalisis sensor, catatan perawatan historis, dan sumber data lain yang relevan, metode ini dapat membantu mengidentifikasi potensi masalah sebelum menjadi masalah besar, memungkinkan tim perawatan untuk melakukan perbaikan atau penggantian sebelum terjadi kerusakan.

Terdapat beberapa manfaat dalam menerapkan strategi perawatan metode prediktif. Ini meliputi:

1. Mengurangi Downtime

Salah satu tujuan utama pemeliharaan prediktif adalah untuk mengidentifikasi potensi kegagalan atau masalah pada peralatan sebelum terjadi, sehingga dapat dilakukan perawatan yang diperlukan tanpa mengganggu operasi normal. Dengan demikian, tujuannya adalah untuk mengurangi downtime atau waktu henti produksi yang tidak direncanakan.

2. Meningkatkan Ketersediaan Peralatan

Dengan memperkirakan waktu perawatan yang diperlukan secara akurat, pemeliharaan prediktif memungkinkan perusahaan untuk menjadwalkan pemeliharaan dengan lebih efisien. Hal ini membantu dalam meningkatkan ketersediaan peralatan, sehingga perusahaan dapat memaksimalkan waktu produksi dengan menyusun jadwal yang lebih akurat dan menghindari penundaan yang tidak diinginkan.

3. Mengurangi Biaya Pemeliharaan

Predictive maintenance memungkinkan perusahaan untuk menghindari pemeliharaan yang tidak perlu atau penggantian komponen yang masih berfungsi dengan baik. Dengan melakukan perawatan tepat waktu berdasarkan prediksi, biaya pemeliharaan dapat diminimalkan, sementara umur pakai peralatan dapat diperpanjang.

4. Meningkatkan Keselamatan Kerja

Dengan mengidentifikasi potensi kegagalan atau masalah pada peralatan sebelum terjadi, predictive maintenance membantu dalam mencegah kecelakaan kerja yang disebabkan oleh kegagalan peralatan. Maka dari itu, predictive maintenance dapat membantu meningkatkan keselamatan kerja dan kesejahteraan karyawan.

5. Optimasi Efisiensi Operasional

Dengan memahami pola kinerja peralatan dan faktor-faktor yang mempengaruhi kinerja mereka, prediktif pemeliharaan memungkinkan perusahaan untuk mengidentifikasi cara-cara untuk meningkatkan efisiensi operasional. Ini bisa berupa penyesuaian proses produksi, pemilihan bahan bakar atau energi yang lebih efisien, atau pengoptimalan parameter operasional lainnya.

6. Meningkatkan Kualitas Produk

Selain memastikan ketersediaan peralatan yang optimal dan menghindari kegagalan yang dapat mempengaruhi proses produksi, prediktif pemeliharaan juga berkontribusi untuk meningkatkan keandalan dan kualitas produk akhir. Ini dapat meningkatkan kepuasan pelanggan dan reputasi perusahaan di pasar.

Perbedaan Preventive Maintenance dan Predictive Maintenance

Sumber: terralogiq.com

Secara umum, preventive dan predictive maintenance adalah dua pendekatan yang berbeda dalam memelihara peralatan. Meskipun keduanya memiliki tujuan yang sama yaitu memperpanjang umur peralatan, mencegah downtime, dan mengurangi biaya pemeliharaan jangka panjang.

Lantas, apakah ada perbedaan diantara keduanya? Perbedaan preventive dan predictive maintenance adalah pada metode dan tujuan dari kedua jenis perawatan. Keduanya memiliki metode dan pendekatan yang berbeda untuk mencapai tujuan tersebut.

1. Perbedaan Berdasarkan Metode

Preventive maintenance adalah jenis perawatan dimana peralatan dirawat secara teratur dan sistematis untuk mencegah kerusakan atau kegagalan dalam operasi normal. Pada metode perawatan ini, peralatan diperiksa, dibersihkan, diolesi dengan pelumas, dan diperbaiki secara berkala sesuai dengan jadwal perawatan yang telah ditentukan.